Jusqu’où privilégier un entraînement à l’échelle aux dépens de la qualité des données ? OpenAI a suivi cette voie avec Whisper, désormais open source.

Entre quantité et qualité des données sources, où se trouve le bon compromis pour entraîner un modèle de reconnaissance vocale multilingue ? Cette question a sous-tendu le développement de Whisper. À la baguette, OpenAI, qui vient de publier le projet sous licence MIT.

Whisper est un transformateur Seq2seq. Bien qu’évalué essentiellement sur la reconnaissance vocale, il peut réaliser d’autres tâches. En l’occurrence, la traduction, l’identification des langues et la détection de la voix.

OpenAI a décidé non pas de s’appuyer sur les ensembles de données de référence, mais de compilateur son propre corpus. Moins qualitatif, avec une phase réduite de préparation des données, mais aussi plus volumineux : 680 000 heures d’audio avec les transcriptions correspondantes. Dans le détail :

– 438 000 heures d’audio en anglais avec transcriptions en anglais

– 126 000 heures dans 98 autres langues avec transcriptions en anglais

– 117 000 heures ces mêmes langues avec transcription correspondante

En toile de fond, des travaux menés, notamment, dans le domaine de la vision par ordinateur (Mahajan et coll., 2018 ; Kolesnikov et coll., 2020). Et qui ont précisément consisté à prendre ses distances avec les jeux de données référents de type ImageNet, en faveur de ensembles de données moins surveillés. Ils avaient permis de constater une meilleure capacité de généralisation sur les modèles entraînés.

OpenAI a publié cinq versions de Whisper, à autant de stades d’entraînement. Tous, sauf le plus grand (1,55 milliard d’hyperparamètres), sont déclinés en multilingue ou en anglais seulement.

![]()

Exception faite de la reconnaissance vocale en anglais, les performances augmentent avec la quantité de données (ASR multilingue, traduction, identification de langues).

![]()

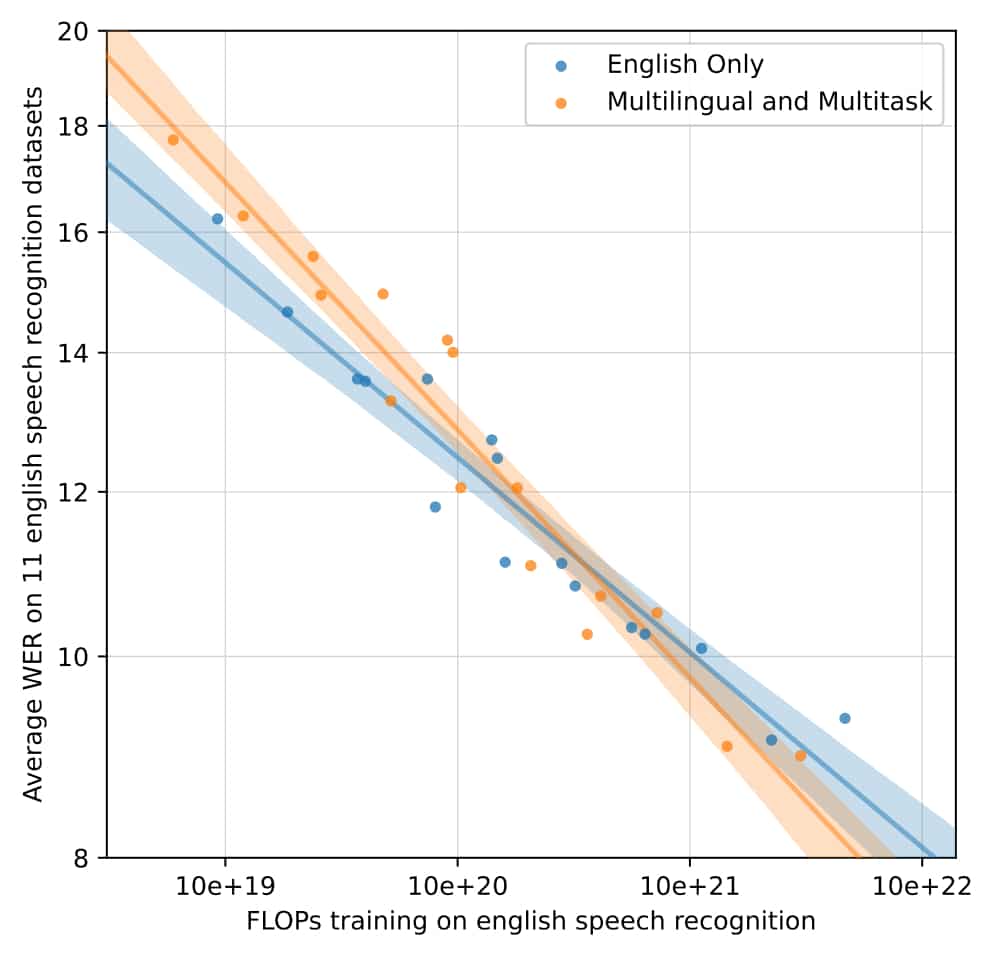

À petite échelle, les modèles « anglais uniquement » ont de meilleurs résultats. Puis la tendance s’inverse en faveur de ceux entraînés sur plusieurs tâches.

Cent fois plus petit que BLOOM

Sur le même créneau, on a récemment vu émerger BLOOM (BigScience Large Open-science Open-access multilingue Language Model). Avec ses 70 couches de neurones, 112 têtes d’attention et 176 milliards de paramètres, il ne joue pas dans la même cour que Whisper. Il faut dire que les moyens qu’il a monopolisés sont sans comparaison.

Un millier de scientifiques se sont impliqués dans son développement, représentant quelque 70 pays et des sociétés comme Airbus, Meta AI, Mozilla, Orange Labs ou Ubisoft. L’entraînement a eu lieu en France, sur le supercalculateur Jean Zay, localisé à Saclay (Essonne). La dotation en ressources de calcul – subvention CNRS + GENCI – pour la première phase d’entraînement est estimée à environ 3 millions d’euros.

À la base de BLOOM, pas d’architecture maison, mais un fork de Megatron-DeepSpeed. Qui lui-même dérive de Megatron-LM (modèle de langage made in NVIDIA à 345 millions de paramètres, architecturé sur le modèle de GPT-2 et entraîné sur Wikipédia, OpenWebText et CC-Stories).

Illustration principale ©